本章节是一些统计学习理论。

题目8.1 - Vapnik-Chervonenkis dimension,VC维

使用

对于

记住,$$\tilde{C}{(N+1,N)} = 2^{N+1}

显然笔者暂时不会证,或者网上已经有大堆博客,这题先放着。

题目8.2 - 分类可变性

假设样本

- 对于两个聚类,分别产生

个数据点 ,当类属为 时, ;当,当类属为 时, 。 - 根据均方误差最小化,得出

。 - 产生根据同样的分布,每个类属产生500个测试样本。

- 分别计算经验(训练)误差以及测试误差。

对于

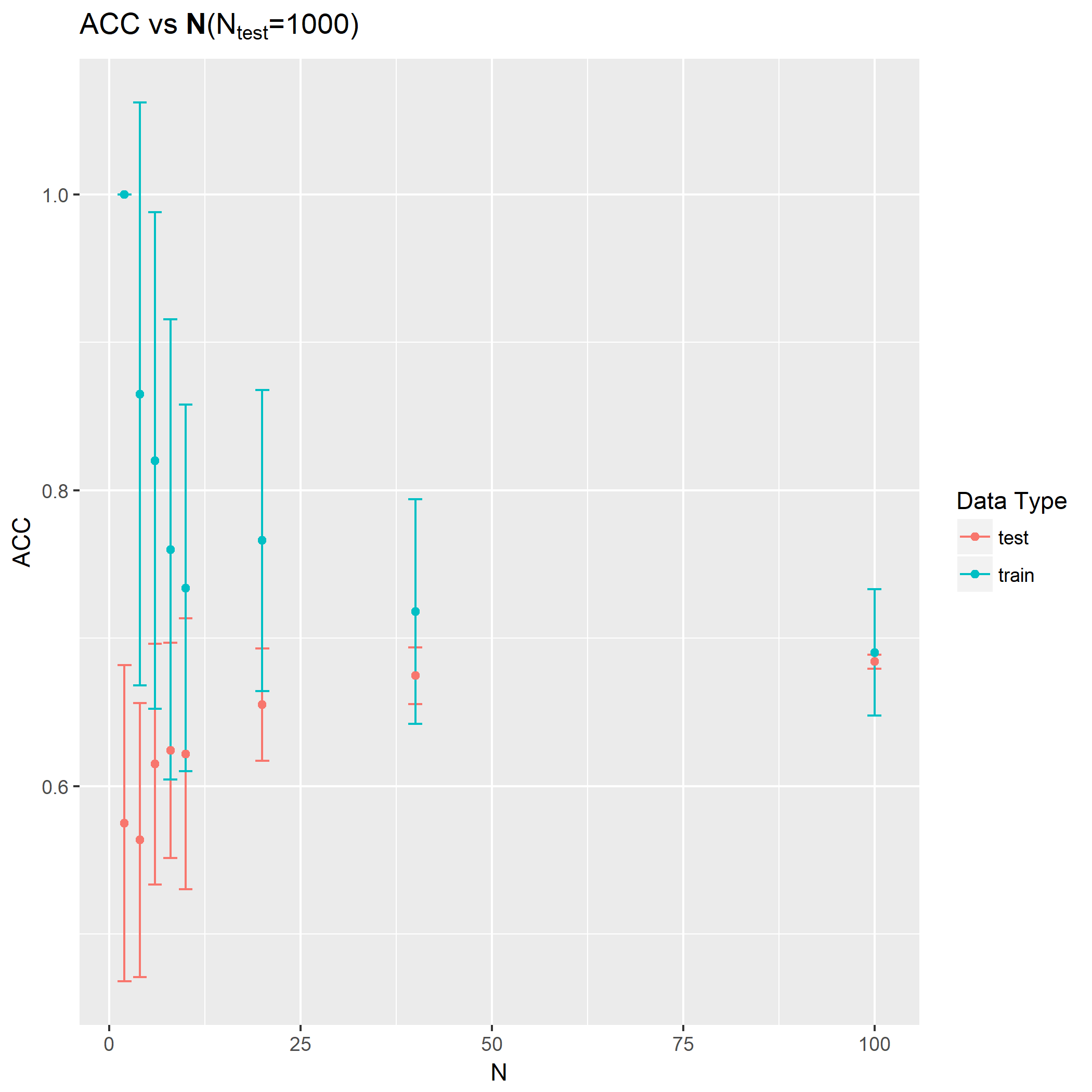

第一问使用误差棒图描绘出每个N下的训练精度以及测试集精度均值和标准差:

可以看到训练样本越少,模型越容易过拟合,泛化性能越差,模型也不稳定(方差大)。

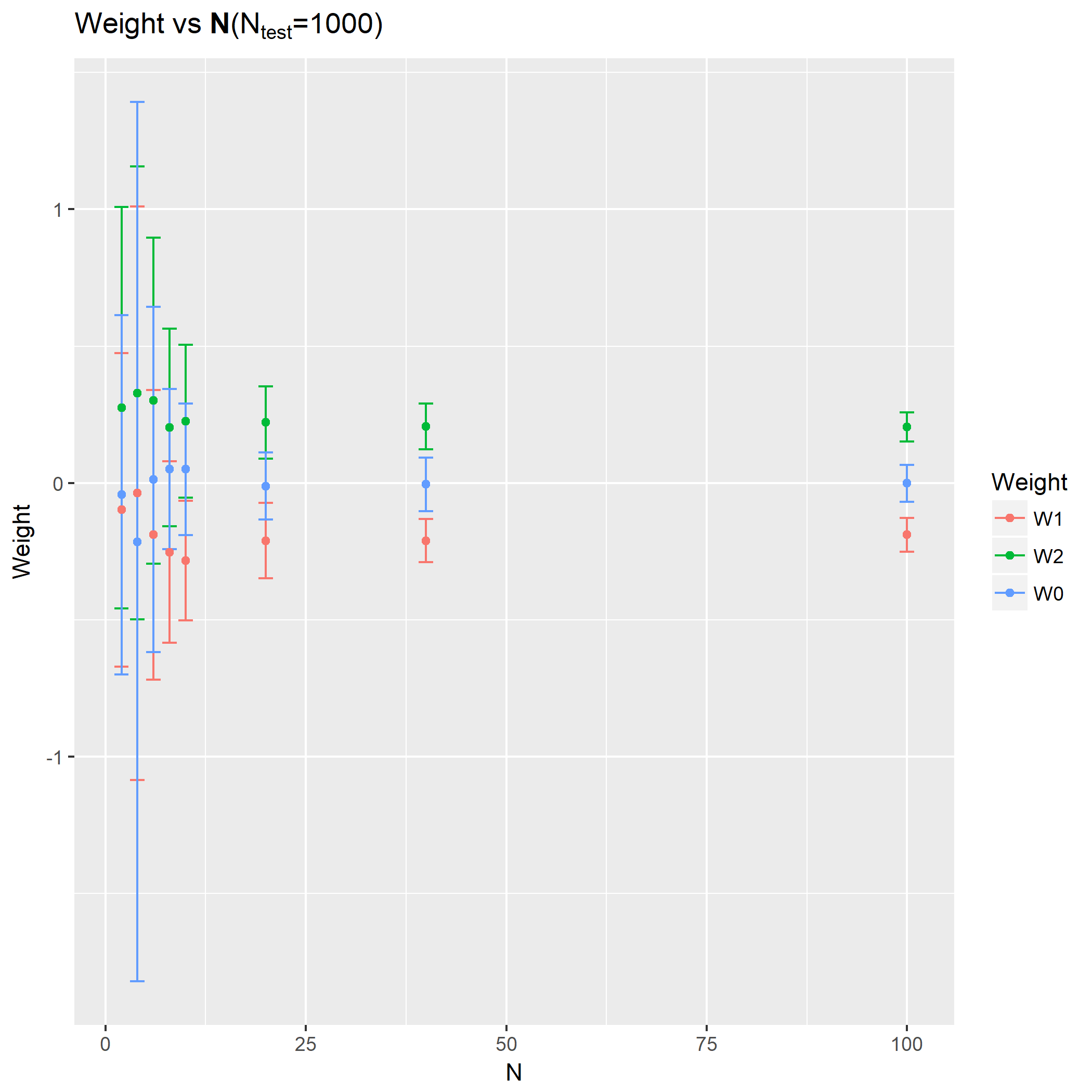

第二问分别绘出

基本情况跟第一问一样,样本越少,重复中出来的参数误差越大。

题目8.3 - 二项分布

本题目涉及三个概率密度函数:

第一个问题是通过不同

第二个问题是什么条件下,可以合理使用正态分布近似二项分布。在

第三个问题是什么条件下,可以使用泊松分布来近似二项分布。当二项分布的

至此第八章的解题结束。